ModelRed

ストックにはログインが必要です

あなたのAIは脆弱です。私たちが証明します。

Artificial Intelligence

Developer Tools

Security

概要

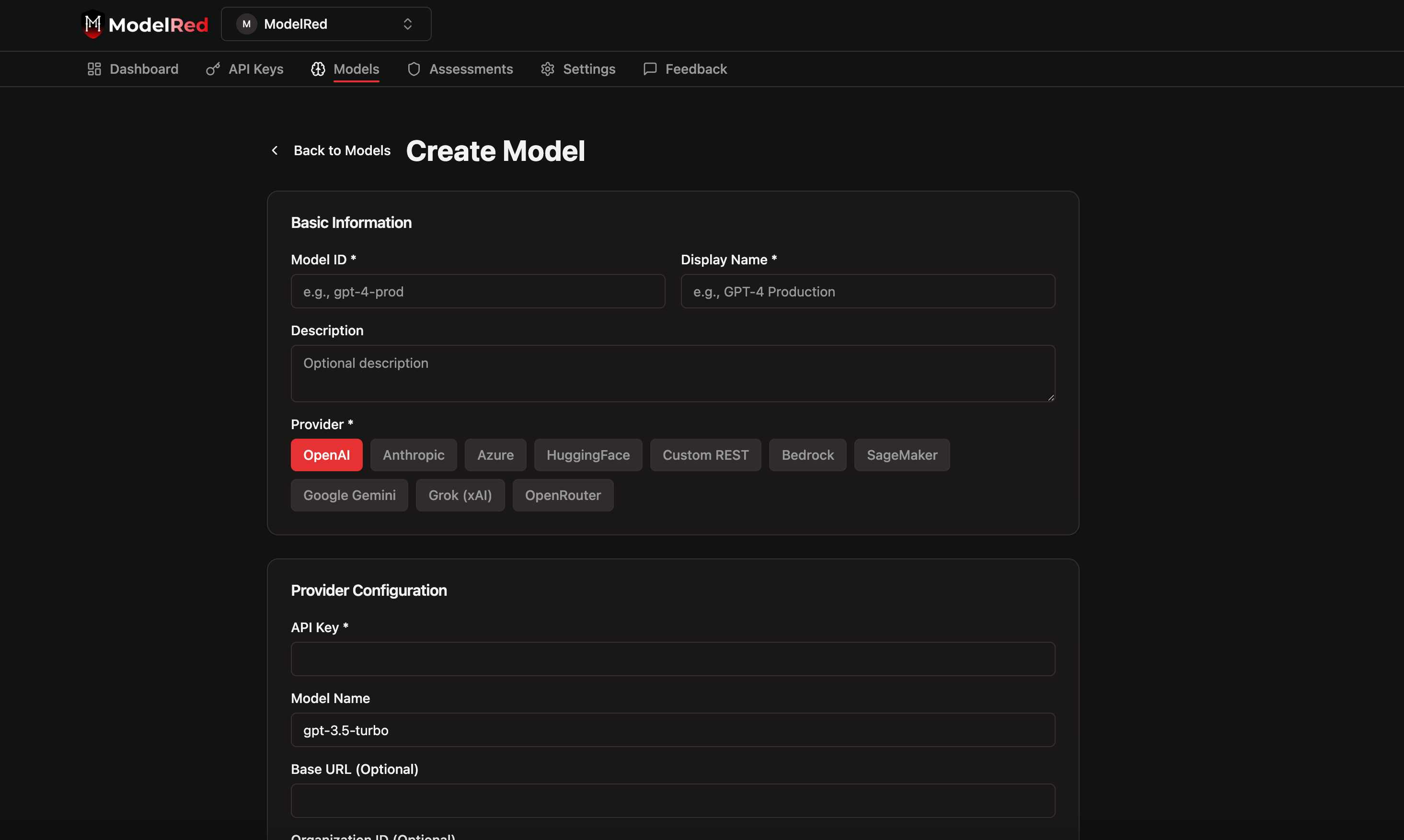

ModelRedは、AIモデルの脆弱性を自動的に発見し、安全性を高めるためのツールです。このプロダクトは、攻撃者の先を行くために、200以上のアダプティブプローブを使用して4000以上の攻撃ベクターをテストします。対応するプラットフォームは多岐にわたり、OpenAI、Anthropic、Azure、AWS、HuggingFaceなどを網羅しています。

特徴

- 自動テスト機能によって、企業が直面するセキュリティテストの負担を軽減

- リアルタイムで進化するプローブにより、実際の脆弱性を早期に発見

- AIセキュリティテストを簡単に実行できる手法を提供

目指す目標

ModelRedの開発者であるNabilは、AIセキュリティの標準としてModelRedスコアを確立することを目指しており、これは過去のウェブ性能基準となったLighthouseと同様の役割を果たすことを目指しています。ハッカーよりも先に自らのAIをテストし、その脆弱性を把握することが重要です。

投票数: 3