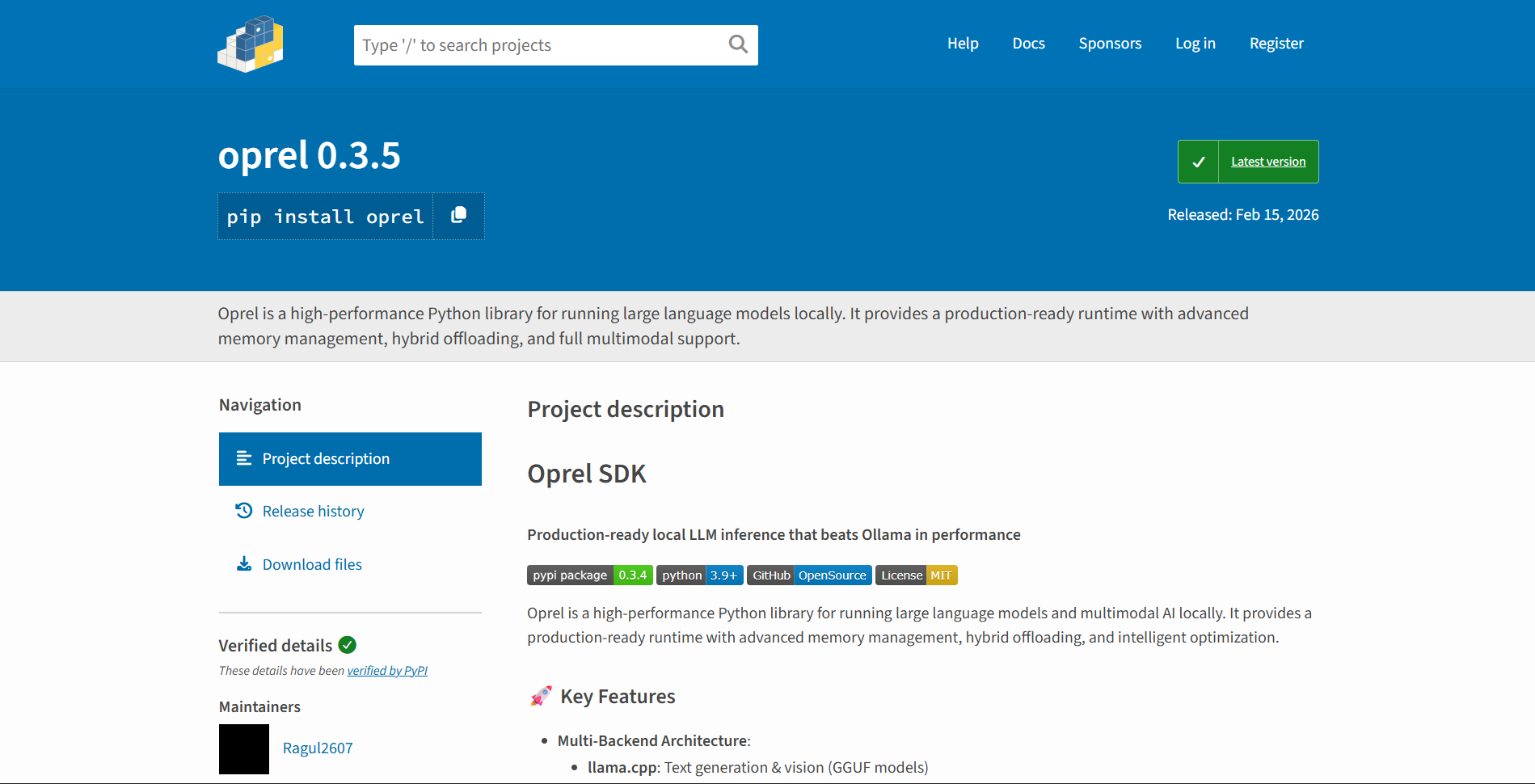

Oprel

ストックにはログインが必要です

実際にあなたのハードウェアを正しく活用するローカルAI

Artificial Intelligence

Developer Tools

GitHub

Open Source

概要

- ローカル環境で大規模言語モデルを実行する高性能なPythonライブラリ。

- GPU/VRAM/RAMを自動検出し最適なバックエンドを選択し、量子化・バッチ処理を自動適用。

- VRAM不足時はGPU/CPUのハイブリッドオフロードで動作を維持し、CUDA失敗時はCPUへフォールバック。

- 中堅GPUで従来より高速、低VRAMではレイヤー分割で大型モデル対応。

- Python中心・pip導入。OpenAI互換APIやComfyUI連携も実験中。

投票数: 2